OpenAIのAI危険対策チームトップが「限界に達し」退社 「安全確保が後回しになっている」

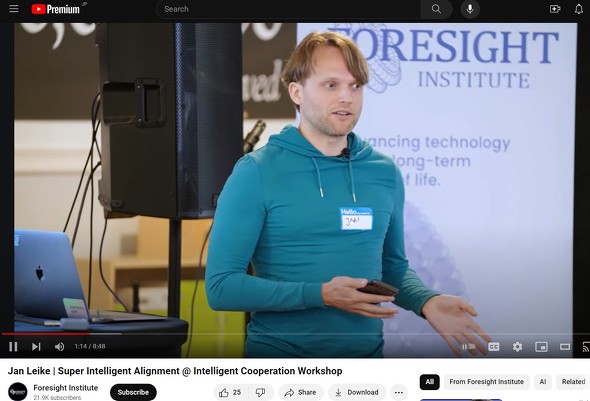

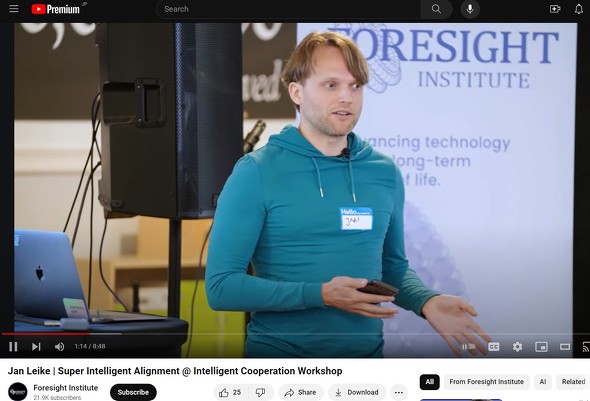

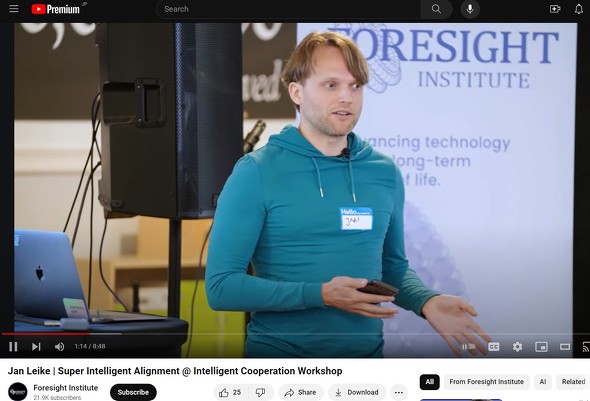

米OpenAIで人間よりもはるかに賢いAI「Superintelligence」(超知能)の制御を目指して昨年結成されたSuperalignmentチームのトップ、ヤン・ライケ氏は5月17日(現地時間)、退社するとXで発表した。

THE NEWS CAMP|ザ・ニュースキャンプ あらゆるジャンルの日々の最新ニュースをお届けしています。

米OpenAIで人間よりもはるかに賢いAI「Superintelligence」(超知能)の制御を目指して昨年結成されたSuperalignmentチームのトップ、ヤン・ライケ氏は5月17日(現地時間)、退社するとXで発表した。